在當今可用于圖像轉(zhuǎn)換的眾多人工智能和機器學(xué)習(xí)模型中,使用生成對抗網(wǎng)絡(luò)(GAN)的圖像到圖像轉(zhuǎn)換模型可以改變圖像的風(fēng)格。

這些模型通過使用兩張輸入圖像來工作:一張內(nèi)容圖像,該圖像被改變以匹配參考圖像的風(fēng)格。這些模型用于將圖像轉(zhuǎn)換為不同的藝術(shù)風(fēng)格、模擬天氣變化、提高衛(wèi)星視頻分辨率以及幫助自動駕駛汽車識別不同的照明條件(如白天和夜晚)等任務(wù)。

據(jù)外媒報道,上智大學(xué)(Sophia University)研究人員開發(fā)出新模型,可以減少運行這些模型所需的計算要求,從而可以在包括智能手機在內(nèi)的各種設(shè)備上運行。

圖片來源:上智大學(xué)

在2024年9月25日發(fā)表在期刊《IEEE Open Journal of the Computer Society》的一項研究論文中,上智大學(xué)信息與通信科學(xué)系的項目助理教授Rina Oh和教授Tad Gonsalves提出一種“單流圖像到圖像轉(zhuǎn)換(SSIT)”模型,僅使用單個編碼器進行這種轉(zhuǎn)換。

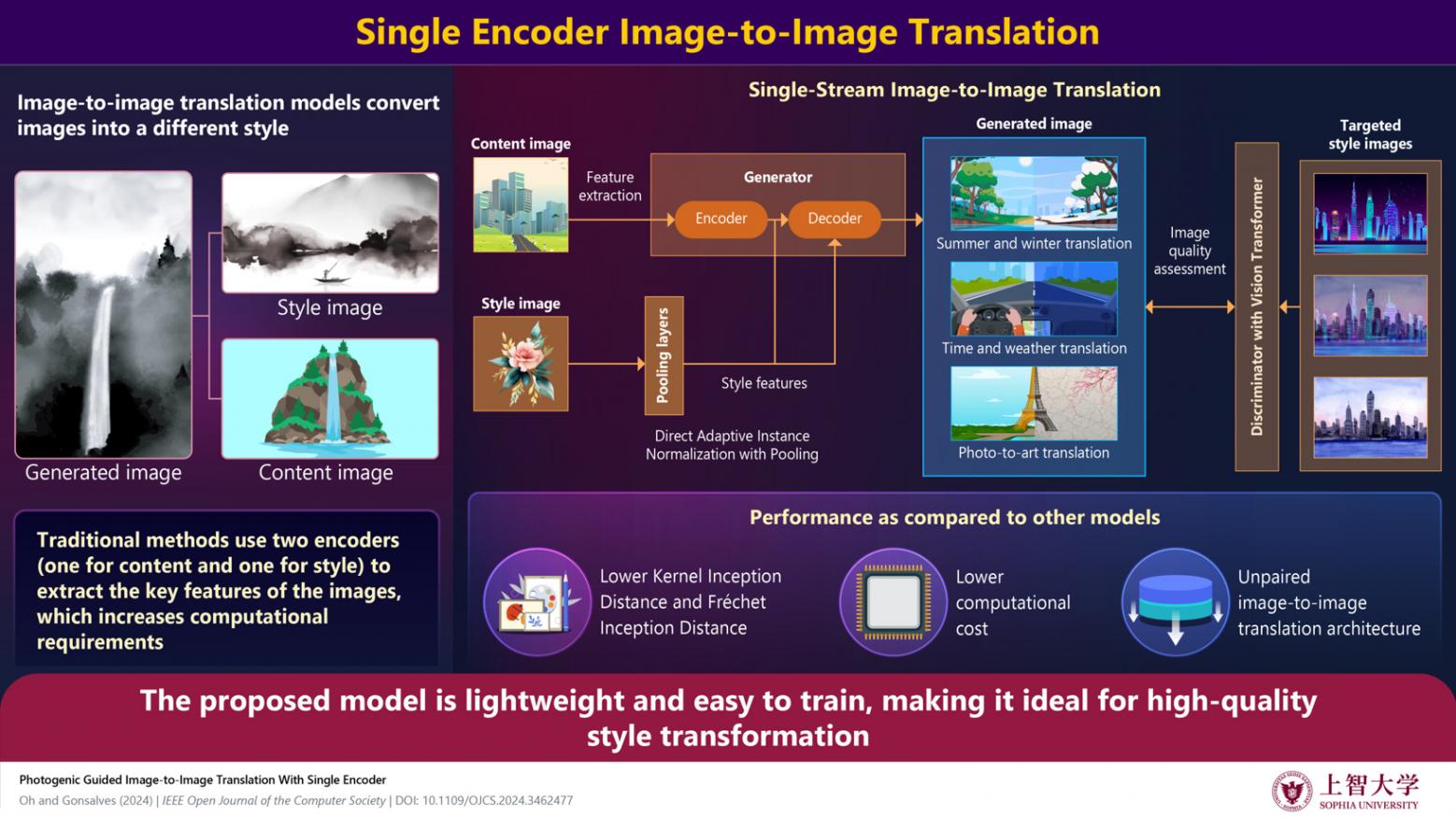

通常,圖像到圖像的轉(zhuǎn)換模型需要兩個編碼器(一個用于內(nèi)容圖像,一個用于風(fēng)格圖像)來“理解”圖像。

這些編碼器將內(nèi)容和風(fēng)格圖像轉(zhuǎn)換為數(shù)值(特征空間),這些數(shù)值代表圖像的關(guān)鍵方面,例如顏色、對象和其他特征。然后,解碼器采用組合的內(nèi)容和風(fēng)格特征,并使用所需的內(nèi)容和風(fēng)格重建最終圖像。

相比之下,SSIT使用單個編碼器來提取空間特征,例如內(nèi)容圖像的形狀、對象邊界和布局。

對于風(fēng)格圖像,該模型使用帶池化的直接自適應(yīng)實例規(guī)范化(DAdaINP),它可以捕獲顏色和紋理等關(guān)鍵風(fēng)格細節(jié),同時專注于最突出的特征以提高效率。然后,解碼器采用組合的內(nèi)容和風(fēng)格特征,并根據(jù)所需的內(nèi)容和風(fēng)格重建最終圖像。

Oh教授表示:“我們實現(xiàn)了一個引導(dǎo)式圖像到圖像轉(zhuǎn)換模型,該模型可以在參考輸入風(fēng)格圖像的同時,以較低的GPU計算成本執(zhí)行風(fēng)格轉(zhuǎn)換。與之前的相關(guān)模型不同,我們的方法利用池化和可變形卷積來高效提取風(fēng)格特征,從而實現(xiàn)高質(zhì)量的風(fēng)格轉(zhuǎn)換,同時降低計算成本并保留內(nèi)容圖像中的空間特征。”

該模型采用對抗訓(xùn)練進行訓(xùn)練,生成的圖像由帶有視覺變換器的鑒別器進行評估,該視覺變換器可捕捉圖像中的模式。鑒別器通過將生成的圖像與目標圖像進行比較來評估生成的圖像是真實的還是假的,而生成器則學(xué)習(xí)創(chuàng)建可以欺騙鑒別器的圖像。

研究人員使用該模型執(zhí)行了三種類型的圖像轉(zhuǎn)換任務(wù)。第一個涉及季節(jié)轉(zhuǎn)換,其中風(fēng)景照片從夏季轉(zhuǎn)換為冬季,反之亦然。

第二項任務(wù)是將照片轉(zhuǎn)換為藝術(shù)作品,即將風(fēng)景照片轉(zhuǎn)換為著名的藝術(shù)風(fēng)格,例如畢加索、莫奈或動漫的風(fēng)格。

第三項任務(wù)側(cè)重于駕駛中的時間和天氣轉(zhuǎn)換,將從汽車前方拍攝的圖像進行修改以模擬不同的條件,例如從白天變?yōu)橐雇砘驈那缣熳優(yōu)殛幱晏鞖狻?/p>

在所有這些任務(wù)中,該模型的表現(xiàn)都優(yōu)于其他五個GAN模型(即NST、CNNMF、MUNIT、GDWCT和TSIT),F(xiàn)réchet初始距離和核初始距離得分較低。這表明生成的圖像與目標風(fēng)格相似,并且在復(fù)制顏色和藝術(shù)細節(jié)方面做得更好。

“與其他模型相比,我們的生成器能夠降低計算成本和FLOP,因為我們使用了一個由多個卷積層組成的編碼器,該編碼器僅用于內(nèi)容圖像,并放置了池化層以從不同角度提取風(fēng)格特征,而不是卷積層,”Oh教授說。

從長遠來看,SSIT模型有可能推動圖像轉(zhuǎn)換的應(yīng)用,使其可以部署在智能手機或個人電腦等設(shè)備上,從而是數(shù)字藝術(shù)、設(shè)計和科學(xué)研究等各個領(lǐng)域的用戶無需依賴昂貴的硬件或云服務(wù)即可創(chuàng)建高質(zhì)量的圖像轉(zhuǎn)換。