誰敢想?

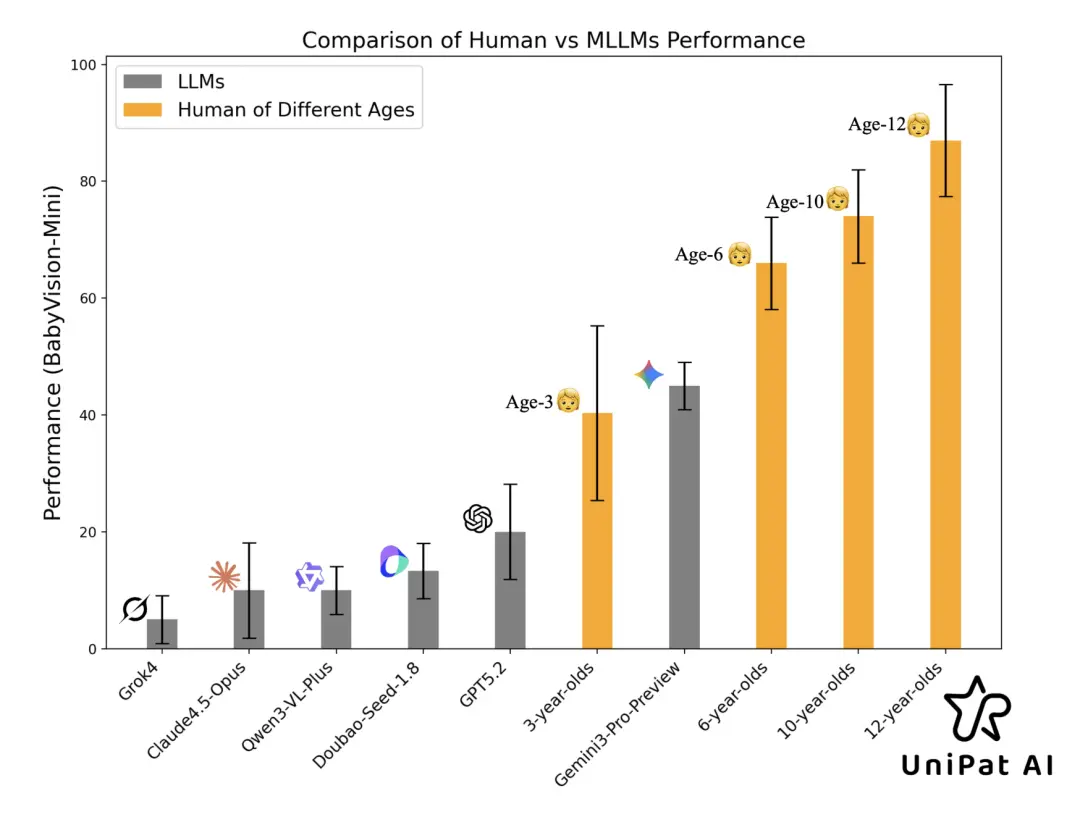

視覺推理這一塊,大模型現(xiàn)在還嫩得像個(gè)3歲小孩。

來自UniPat AI、xbench、阿里、月之暗面、階躍星辰等多家研究機(jī)構(gòu)的最新研究顯示:

在BabyVision視覺推理benchmark上,當(dāng)前表現(xiàn)最強(qiáng)的Gemini 3 Pro Preview也只是小勝三歲兒童,跟六歲兒童仍有20%的差距。

與成年人94.1的水平相比,更是天壤之別。

更關(guān)鍵的是,Gemini 3 Pro Preview已經(jīng)是當(dāng)前一眾模型中的“天花板”。

其他前沿模型,包括GPT-5.2、Claude 4.5 Opus、Grok-4等,整體表現(xiàn)甚至不如三歲小孩。

這一扎心結(jié)論,無疑又給當(dāng)前基于VLA(M)的具身智能潑了盆冷水。

畢竟,一個(gè)視覺能力尚未達(dá)到三歲兒童水平的AI,很難被指望在真實(shí)物理世界中穩(wěn)定、安全地協(xié)助人類。

也正是在這個(gè)意義上,BabyVision還給出了另一種視角:

要真正推進(jìn)多模態(tài)智能,未來的模型必須從底層重建視覺能力,而不是繼續(xù)依賴將視覺問題翻譯成語言來“繞行”。

視覺推理的語言化瓶頸

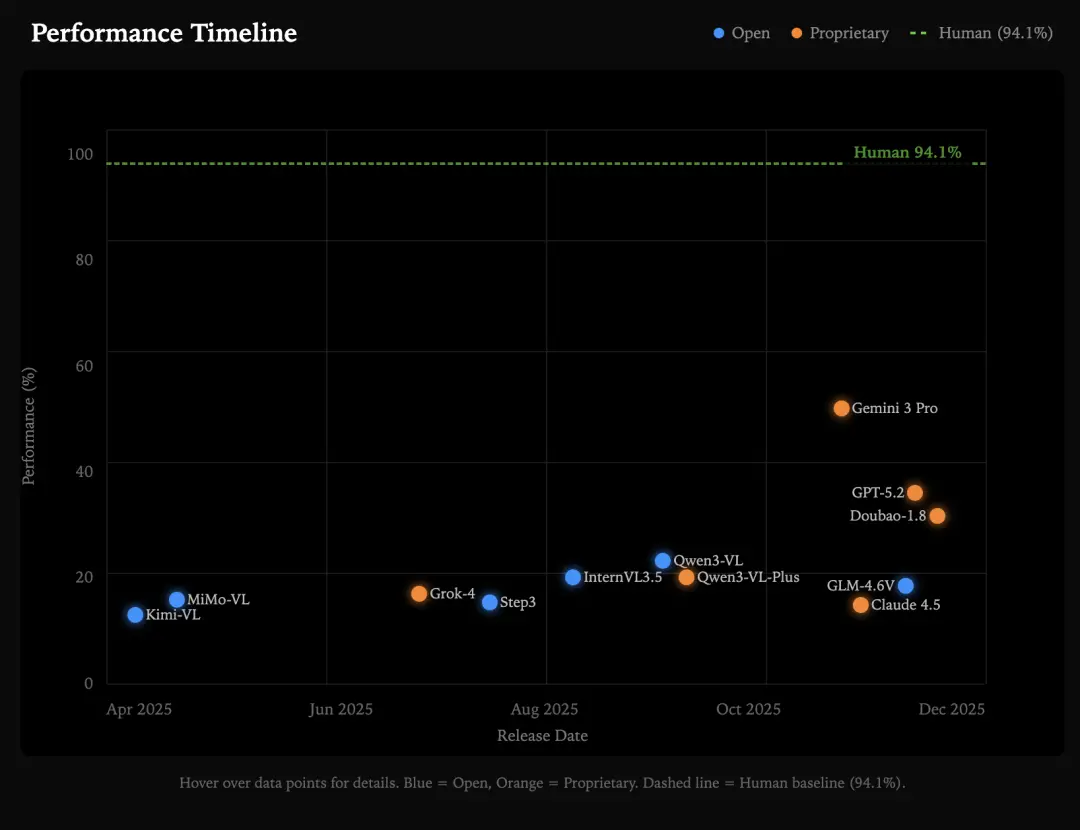

在完整的評(píng)估中,研究對(duì)比了開源和閉源模型的表現(xiàn):

在閉源模型中: Gemini 3-Pro-Preview以49.7%的得分領(lǐng)跑,隨后是GPT-5.2 (34.4%) 和豆包-Seed-1.8 (30.2%)。

其余模型表現(xiàn)則不盡人意:Qwen3-VL-Plus 19.2%,Grok-4 16.2%,Claude-4.5-Opus 14.2%。

在開源模型中,表現(xiàn)最好的是Qwen3VL-235B-Thinking,總分達(dá)到22.2%。

其中,Qwen3VL的Thinking版本優(yōu)于Instruct版本,這表明顯示顯式推理能減輕視覺不確定性。

此外,即使是最大的開源模型,仍無法與頂尖閉源系統(tǒng)匹敵。

那么,問題來了。

為什么在HLE、IMO等高難度任務(wù)中展現(xiàn)出博士級(jí)“智商”、甚至能解數(shù)學(xué)難題的大模型,卻會(huì)在一些看似簡(jiǎn)單的“找不同”任務(wù)中頻頻翻車?

先說結(jié)論:當(dāng)前的多模態(tài)大模型,通常是在推理前,先將視覺輸入轉(zhuǎn)化為語言表征來處理。

這種做法充分利用了大型語言模型強(qiáng)大的推理能力,但也引入了一個(gè)根本性的限制:

凡是無法被語言準(zhǔn)確表達(dá)的視覺信息,都會(huì)在這一過程中被丟失。

例如,圖像中“一輛紅色的汽車”可以被輕松轉(zhuǎn)寫為文字;但更細(xì)粒度的幾何信息,如邊界的精確曲率、交叉點(diǎn)的具體位置、相對(duì)空間關(guān)系的微小變化,卻很難被語言忠實(shí)描述。

而正是這些“不可描述”的視覺特征,構(gòu)成了BABYVISION任務(wù)的核心難點(diǎn),也因此成為當(dāng)前頂尖多模態(tài)模型普遍折戟的地方。

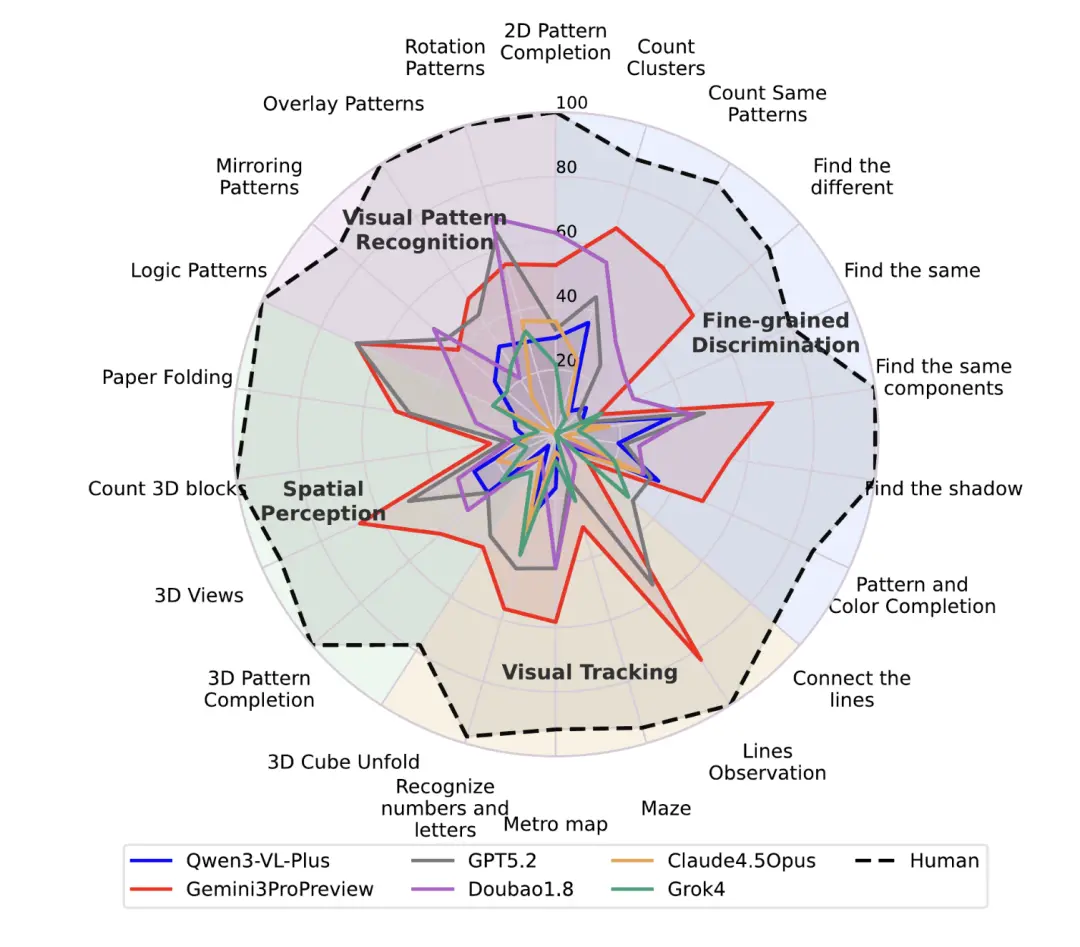

具體來說,BabyVision將視覺推理拆解為4個(gè)核心能力維度:

細(xì)粒度辨別(Fine-grained Discrimination):檢測(cè)細(xì)微的視覺差異

視覺追蹤(Visual Tracking):追蹤路徑、線條和運(yùn)動(dòng)軌跡

空間感知(Spatial Perception):理解三維結(jié)構(gòu)與空間關(guān)系

視覺模式識(shí)別(Visual Pattern Recognition):識(shí)別視覺中的邏輯與幾何規(guī)律

基于上述能力維度,研究總結(jié)出當(dāng)前MLLM面臨的四個(gè)經(jīng)典視覺核心挑戰(zhàn),具體如下:

非言語性精細(xì)細(xì)節(jié)的缺失

首先是非言語性精細(xì)細(xì)節(jié)的缺失,這些精細(xì)細(xì)節(jié)往往難以被語言精準(zhǔn)地描述。

比如在面對(duì)一個(gè)小的偏移、特定的邊界曲線,或者僅僅是一個(gè)像素的差異時(shí),多模態(tài)大模型(MLLMs)往往會(huì)把這些截然不同的選項(xiàng)當(dāng)作差不多的來處理。

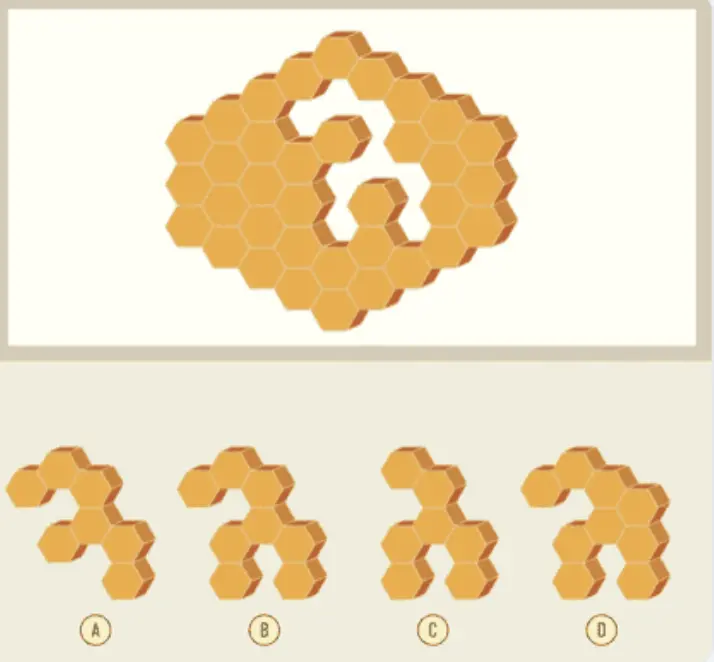

以表現(xiàn)最好的Gemini 3 Pro Preview為例,在下面的找拼圖任務(wù)中,它就錯(cuò)誤地選擇了D選項(xiàng)。

(正確答案:B)

在Gemini的推理過程中,它首先將形狀轉(zhuǎn)化為文字描述,再簡(jiǎn)化為粗略特征(如數(shù)量、拓?fù)浣Y(jié)構(gòu)),然后在語言空間中對(duì)比候選選項(xiàng)。

相比之下,人類直接通過形狀匹配瞬間完成任務(wù)。人類的大腦會(huì)對(duì)每個(gè)候選選項(xiàng)進(jìn)行平移和旋轉(zhuǎn),檢查邊界是否對(duì)齊,整個(gè)過程無需借道文字,直接由幾何驅(qū)動(dòng)。

所以,這里的關(guān)鍵不在于邏輯的難度,而在于高保真感知的缺失。

流形一致性(Manifold Identity)的丟失

此外,研究還發(fā)現(xiàn),多模態(tài)大模型難以在長距離空間中,可靠地維持感知的一致性。

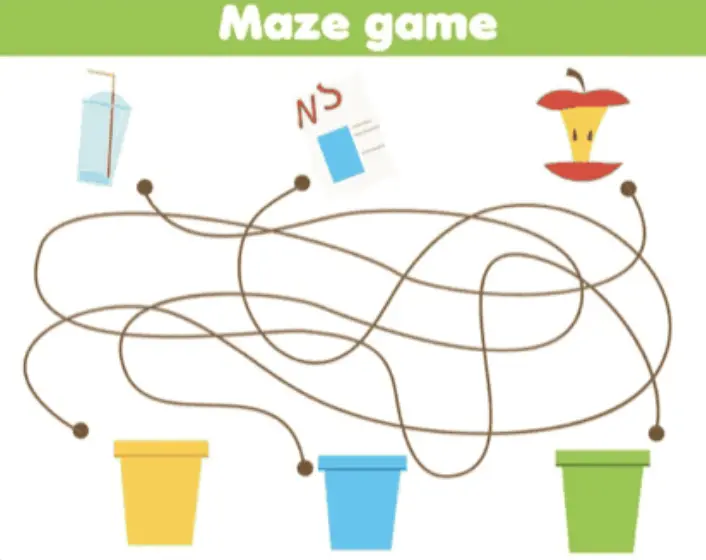

比如,在下面的連線任務(wù)中,Gemini 3 Pro Preview再度失敗,錯(cuò)誤地將塑料瓶連在了綠色垃圾桶中,以及將蘋果核連在了藍(lán)色垃圾桶中,

(正確答案:塑料瓶-藍(lán)、試卷-黃,蘋果核-綠)

研究發(fā)現(xiàn),Gemini在解題時(shí),通常會(huì)把一條連續(xù)的曲線拆解成一連串簡(jiǎn)單指令,比如向左、向右、向上、向下。

但問題在于,一旦出現(xiàn)交叉點(diǎn),這種拆解方式就會(huì)讓路徑變得模糊,很容易走岔。

由于模型并沒有在腦子里“真正記住”那條曲線的樣子,它在經(jīng)過交叉點(diǎn)后就可能無意中換到另一條線上。

這種錯(cuò)誤對(duì)人類來說幾乎一眼就能看出來,但當(dāng)信息被壓縮成文字后,反而很難察覺。

相比之下,人類一般會(huì)直接盯住一條線,一路跟到終點(diǎn)。而這種能力在人類幼兒時(shí)期就已經(jīng)很自然地具備了。

空間想象力

研究發(fā)現(xiàn)的第三個(gè)普遍挑戰(zhàn)是“空間想象力”,也就是從二維圖像中構(gòu)建穩(wěn)定的三維內(nèi)部表征,并在保持結(jié)構(gòu)不變的前提下,對(duì)其進(jìn)行心理變換——

比如切換視角、投影輪廓,或推斷被遮擋的體積。

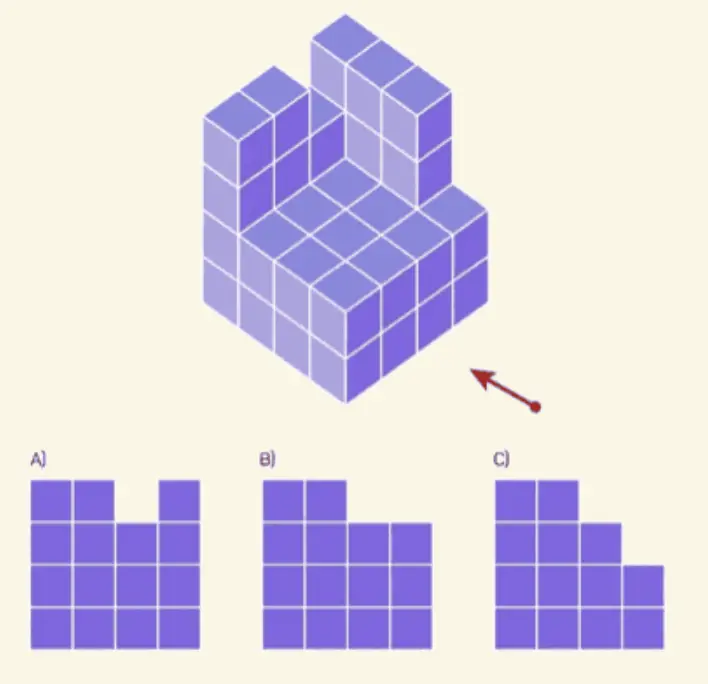

舉例來說:給你一個(gè)視圖,讓你想象如果從側(cè)面看,它應(yīng)該是什么樣子。

在這一任務(wù)中,Gemini 3 Pro Preview仍然選擇了錯(cuò)誤的C選項(xiàng)。

(正確答案:A)

在 Gemini 的推理過程中,模型會(huì)先將視覺場(chǎng)景轉(zhuǎn)化為語言摘要,用文字描述物體,再基于這些文字去“猜測(cè)”二維特征。

但問題也正出在這里——文字?jǐn)⑹霾⒉荒苤覍?shí)地表示空間狀態(tài)。

一旦精確的圖像被壓縮成模糊的文本摘要,模型就很容易犯下可預(yù)期的錯(cuò)誤:漏掉被遮擋的積木、數(shù)錯(cuò)層數(shù),或使用了錯(cuò)誤的三維投影關(guān)系。

相比之下,人類可以直接在腦海中從指定方向“轉(zhuǎn)動(dòng)”物體并進(jìn)行對(duì)比,整個(gè)過程幾乎不需要語言的參與。

視覺模式歸納

第四個(gè)挑戰(zhàn)是視覺模式歸納:也就是從少量視覺示例中,總結(jié)出通用的變化規(guī)則,并把它應(yīng)用到新的輸入上。

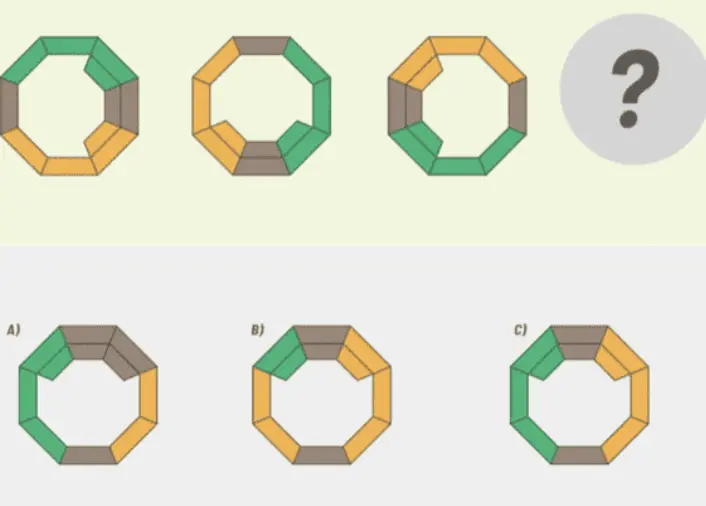

在下面這個(gè)找規(guī)律的問題中,QWEN3-VL-PLUS選擇了錯(cuò)誤的B選項(xiàng)。

(正確答案:C)

模型在這類任務(wù)中常見的做法,并不是理解“發(fā)生了什么變化”,而是去數(shù)屬性。

比如,顏色有多少、形狀有幾個(gè)、元素是否相似。它會(huì)描述源圖像、描述目標(biāo)圖像,然后試圖在文本層面把兩者“對(duì)上”。

相較之下,人類在處理這類問題時(shí),通常會(huì)直接對(duì)比前后的視覺示例,在腦中形成一個(gè)簡(jiǎn)單的“因果圖”:

哪個(gè)形狀包含哪個(gè)形狀?誰是框架,誰是內(nèi)容?這些角色在從輸入到輸出的過程中是如何被重新分配的?

正是這種對(duì)視覺關(guān)系進(jìn)行抽象推理的能力——而非簡(jiǎn)單的識(shí)別——構(gòu)成了當(dāng)前模型架構(gòu)仍難以跨越的一道門檻。

基于RLVR與生成式建模的視覺推理

那么, 既然基于文本的視覺推理(如 VLM)存在天然局限,那么有沒有辦法對(duì)這一點(diǎn)加以改善?

對(duì)此,研究給出了兩個(gè)方向:基于可驗(yàn)證獎(jiǎng)勵(lì)的強(qiáng)化學(xué)習(xí)(Reinforcement Learning with Verifiable Rewards ,RLVR)以及基于生成模型的視覺推理。

首先來看RLVR。

具體而言,研究以Qwen3-VL-8B-Thinking作為基座模型,并在其上進(jìn)行RLVR微調(diào)。

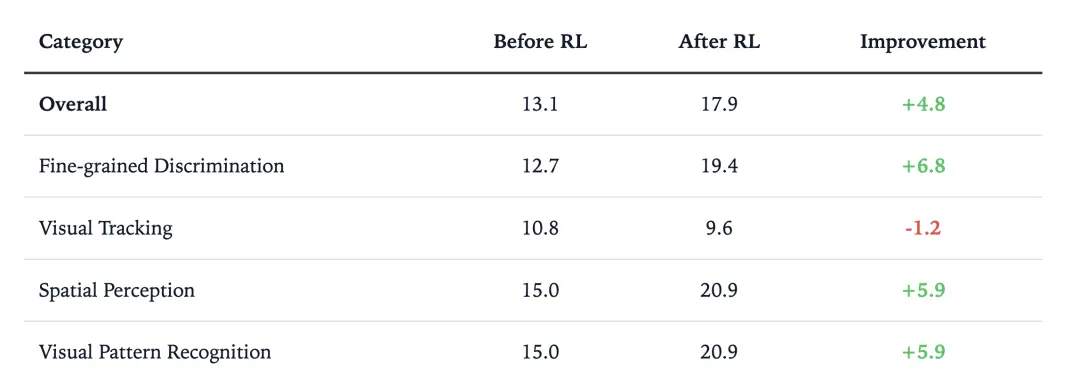

實(shí)驗(yàn)表明,在完成RLVR微調(diào)后,模型整體準(zhǔn)確率提升了約4.8個(gè)百分點(diǎn)。從任務(wù)子類分布來看,大多數(shù)類別均出現(xiàn)不同程度的提升。

這和在Qwen推理模型中得到的洞見一致:一旦提取出視覺信號(hào),顯式的中間推理可以部分抵消視覺上的不確定性。

接下來是生成模型方法。

既然以語言承載視覺推理存在天然的“信息失真”,模型能否效仿人類,通過“視覺重構(gòu)”——

即在像素空間內(nèi)直接演算(如繪制連線或補(bǔ)全圖案)來完成推理。

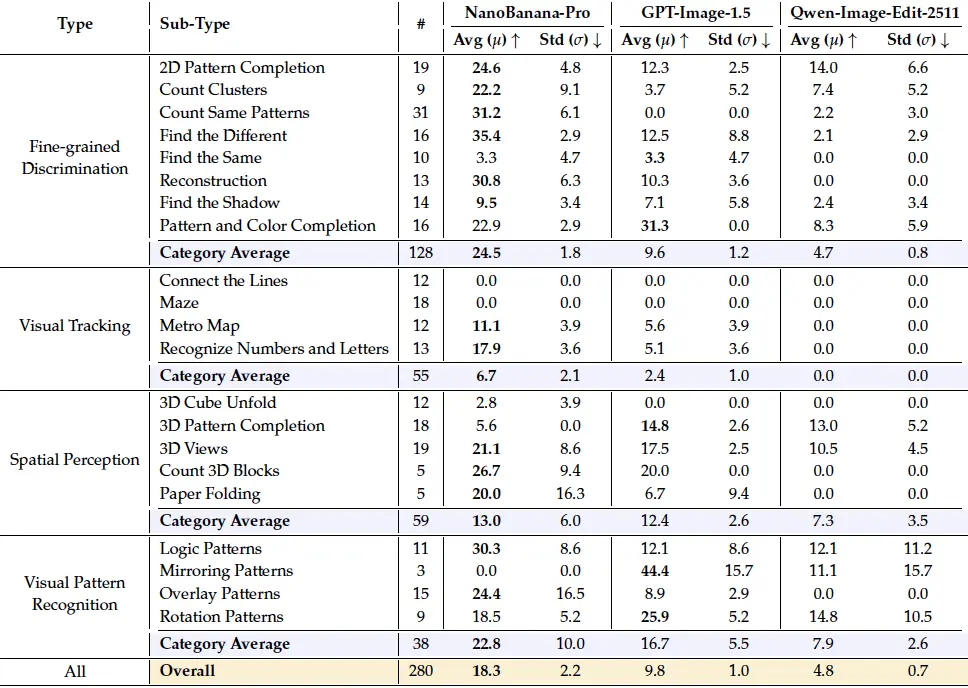

基于這一認(rèn)識(shí),研究推出了BabyVision-Gen,評(píng)估了3種前沿視覺生成模型:NanoBanana-Pro、GPT-Image-1.5和Qwen-Image-Edit在其之上的表現(xiàn)。

(注:BabyVision-Gen從全量基準(zhǔn)中篩選出280道適合生成式交互的題目,要求模型直接輸出圖像或視頻流來表達(dá)解題過程)

實(shí)驗(yàn)結(jié)果顯示:NanoBanana-Pro表現(xiàn)最優(yōu),準(zhǔn)確率達(dá)18.3%;而GPT-Image-1.5與Qwen-Image-Edit分別為9.8%和4.8%。

雖然成功率仍然不高,但研究認(rèn)為,NanoBanana-Pro與Sora-2等模型展現(xiàn)出了顯式視覺思維,能夠沿邏輯路徑生成物理軌跡。

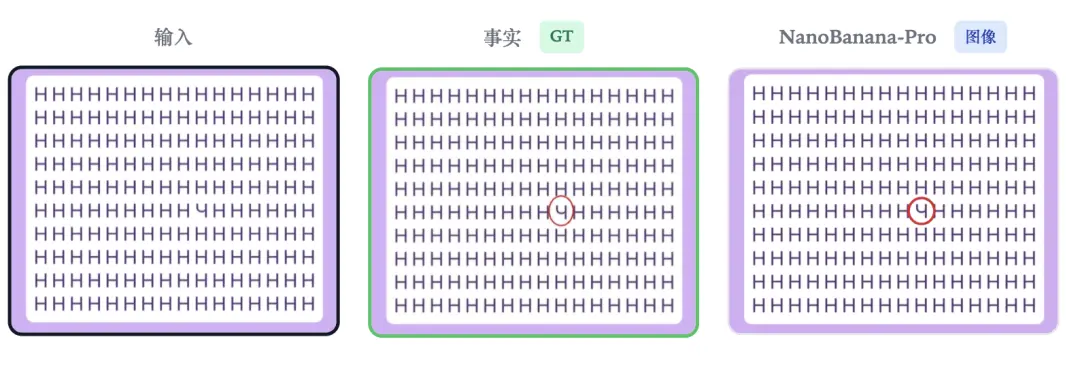

此外,在相似的字母中找不同的任務(wù)里,基于生成式的方法也表現(xiàn)出了一定的視覺思維能力。

這里的失誤也表明:?jiǎn)渭兊纳赡芰Σ⒉坏韧趪?yán)密的推理,生成過程還必須由穩(wěn)健的視覺語義理解(Visual Understanding)進(jìn)行引導(dǎo)。

由此,研究繞過“語言瓶頸”的統(tǒng)一架構(gòu),揭示了一個(gè)關(guān)鍵的研究趨勢(shì):將生成模型轉(zhuǎn)化為原生多模態(tài)推理器。

相比于傳統(tǒng)的MLLM強(qiáng)行將視覺信號(hào)壓縮成文本,像Bagel這樣的統(tǒng)一架構(gòu),能夠在推理過程中保留高保真的視覺表征。

這種架構(gòu)允許模型在視覺空間內(nèi)進(jìn)行“顯式思考”——通過勾勒中間步驟、突出關(guān)鍵區(qū)域或?qū)崟r(shí)繪制軌跡來解析問題。

同時(shí),像Sora 2和Veo 3等模型在建模物理動(dòng)力學(xué)與空間關(guān)系的能力上,進(jìn)一步支持了“生成本身即是推理的一種高級(jí)形式”這一觀點(diǎn)。